Autofokus bei spiegellosen Kameras – Wie er funktioniert und wo seine Schwächen liegen

Die Zeiten, in denen Objektive mit rein manuellem Fokus verwendet wurden, sind schon lange vorbei, und die Geschwindigkeit der Entwicklung nimmt immer mehr zu. Die heutigen Autofokussysteme sind selbst im Vergleich zu High-End-Spiegelreflexkameras des letzten Jahrzehnts ein wahres Wunderwerk. Leider können sie aber immer noch nicht die Gedanken des Fotografen lesen. Daher ist es gut, ein Gefühl dafür zu entwickeln, wie sie funktionieren und wo sie versagen könnten.

In diesem Artikel werde ich mich auf die aktuellen Konzepte der Fokussierung konzentrieren und nicht explizit auf technische Details eingehen. Denn diese variieren von Hersteller zu Hersteller und jeder von ihnen hält sie geheim, weshalb sie auch nicht öffentlich zugänglich sind. Darüber hinaus sind neue Technologien zunehmend eine Frage der Software, sodass sich der Algorithmus in der nächsten Kamerageneration anders verhalten kann, und es kommt auch häufig vor, dass Ihr bestehendes Gerät dank eines Firmware-Updates neue Fähigkeiten erlangt.

Das Update muss manuell durchgeführt werden. Wenn Sie das normalerweise nicht tun, empfehle ich Ihnen, im Internet nach einer neueren Version der Firmware zu suchen.

In diesem Artikel verwende ich Beispiele von meiner Canon R5 Kamera, andere spiegellose Kameras funktionieren aber auf ähnliche Weise.

Für die Autofokussierung sind vor allem zwei Technologien wichtig: die Phasenverschiebungserkennung und die Objekterkennung im Bild. Lassen Sie uns diese beiden Technologien genauer beschreiben.

Erkennung einer Phasenverschiebung

Die Idee der Phasenerkennung (Phase Detection) entstand bereits zu Zeiten der Spiegelreflexkameras, wurde aber seitdem nur noch weiterentwickelt. Um den Trick zu verstehen, möchte ich mit einem kleinen Exkurs darüber beginnen, wie wir Objekte überhaupt sehen.

Alles beginnt mit dem Licht der Sonne oder einer anderen Lichtquelle.

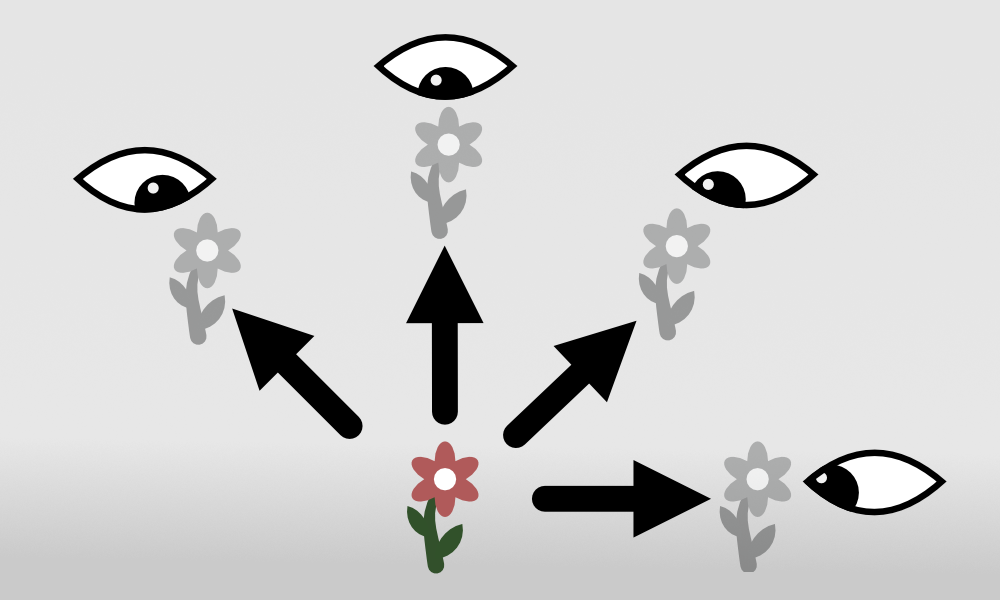

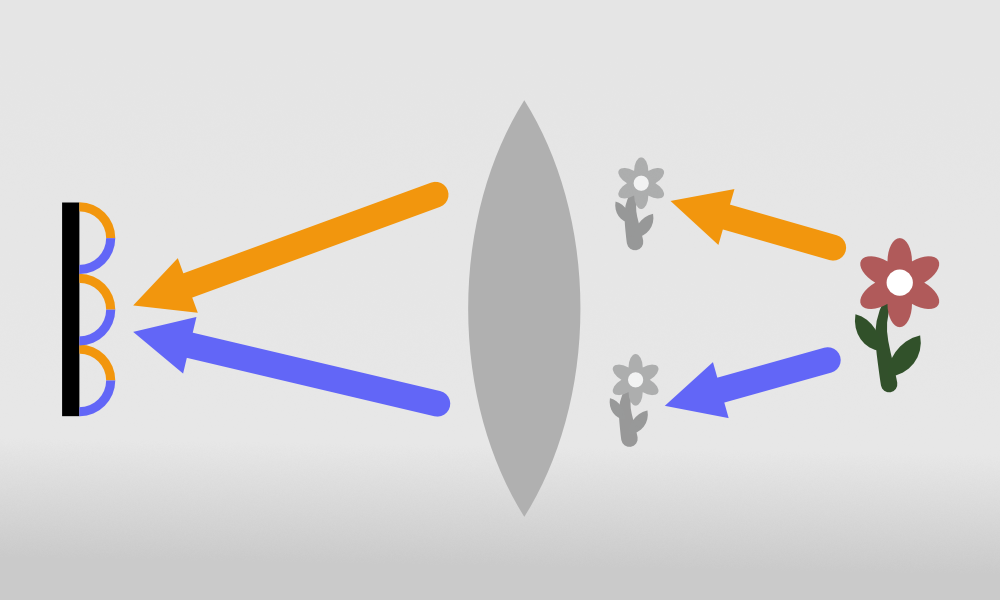

Das einfallende Licht wird vom Objekt in alle Richtungen reflektiert (der Einfachheit halber gehe ich von einer normalen diffusen Reflexion aus). Deshalb können wir es von überall aus beobachten. Das Objekt sendet seine Bilder in alle Richtungen.

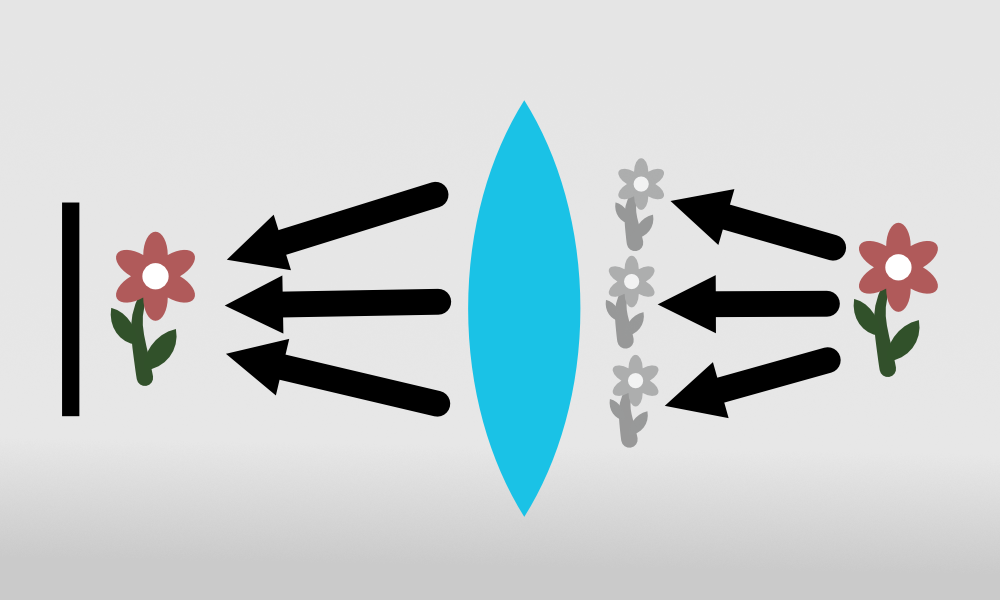

Das Objektiv sammelt und fokussiert mehrere dieser Bilder an der gleichen Stelle – auf dem Sensor (je größer übrigens die Lichtstärke, desto mehr Bilder kann es sammeln).

In Spiegelreflexkameras gab es einen zweiten speziellen Sensor, der in verschiedene Richtungen blickte, um Bilder aus unterschiedlichen Richtungen unterscheiden und vergleichen zu können.

Wenn die Bilder korrekt fokussiert sind, können sie am Schärfepunkt genau übereinander gelegt werden. Wenn nicht, sind sie relativ zueinander verschoben. Über den Grad der Verschiebung kann die Kamera berechnen, um wie viel der Objektivmotor bewegt werden muss, damit alles scharfgestellt wird.

Bei spiegellosen Kameras wird kein spezieller Chip benötigt, denn der Hauptsensor selbst übernimmt das „Schauen“ in verschiedene Richtungen. Jedes seiner Pixel ist in zwei Hälften geteilt, sodass er zwischen Licht von links und rechts unterscheiden kann.

Wenn Sie dann auf das Objekt „oben rechts“ fokussieren möchten, wird eine Gruppe benachbarter Pixel in diesem Bereich ausgewählt und diese Bereiche der eingehenden Bilder werden verglichen. Auf diese Weise kann die Kamera genau fokussieren.

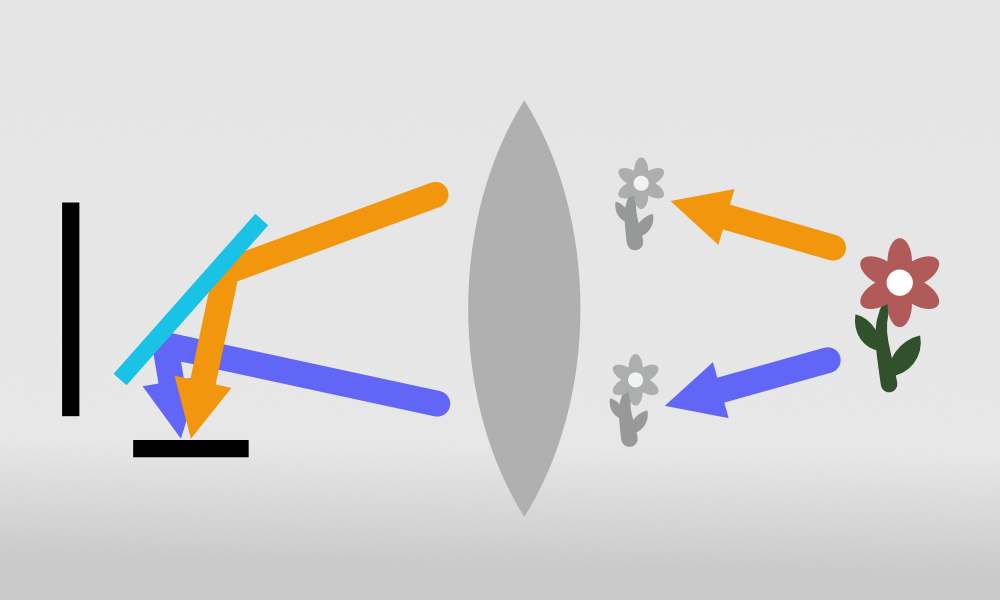

Die Phasenverschiebungserkennung ist, obwohl sie modifiziert wurde, nicht revolutionär, und Besitzer besserer Spiegelreflexkameras mit vielen Fokuspunkten sind im Grunde immer noch gleich gut oder vielleicht sogar besser dran. Tatsächlich erkennen Spiegelreflexkameras normalerweise nicht nur Licht, das von links und rechts kommt, sondern auch von oben und unten und in einigen Fällen sogar schräg von den Seiten.

Spiegellose Kameras haben derzeit Probleme mit der Fokussierung auf einförmige Dinge, die sich nicht von links nach rechts verändern, wie etwa horizontale Jalousien. In Zukunft könnten die Pixel nicht mehr in zwei, sondern vielleicht in vier oder mehr Teile aufgeteilt werden, was die Fokussierung verbessern würde.

Aber dieser Schritt der Verschiebungserkennung ist nur eine Vorstufe zum zweiten Schritt, der schon wirklich revolutionär ist.

Erkennung von Objekten im Bild

Die Bilderkennung gab es bei Spiegelreflexkameras schon so halbwegs. Wenn Sie nicht ausdrücklich einen bestimmten Fokuspunkt gewählt haben, konnte die Kamera zum Beispiel das nächstgelegene Objekt für Sie auswählen. Einige Spiegelreflexkameras konnten auch ein Gesicht erkennen (Nikon 3D-Tracking Face Detection).

Die Erkennung erfolgt jedoch mithilfe eines sekundären Chips mit einer geringen Auflösung von Tausenden von Pixeln. Spiegellose Kameras setzen noch einen drauf und erkennen Objekte mithilfe des Hauptsensors mit Millionen von Pixeln. Dazu hat auch die Entwicklung von Prozessoren beigetragen, die solche Datenmengen verarbeiten können.

Je nach Einstellung können spiegellose Kameras automatisch gezielt nach Gesichtern, Fahrzeugen oder Tieren suchen.

Menschen sind in der Fotografie ein besonders wichtiges Ziel. Daher können die Systeme nicht nur auf Gesichter, sondern auch direkt auf das Auge fokussieren. Eine ähnliche Präzision ist bei Objektiven mit großer Lichtstärke erforderlich, bei denen jeder Zentimeter schlechter Fokussierung deutlich sichtbar ist.

Mit den Tasten können Sie zwischen den Augen und der gesamten menschlichen Figur umschalten. Bei Szenen mit ungewöhnlichen Motiven hat der Fotograf die Möglichkeit, ein eigenes Motiv in der Szene auszuwählen, das das Fokussierungssystem dann versucht, zu erfassen.

Kontinuierliche Fokussierung

Bisher habe ich beide Schritte als abgeschlossene Vorgänge beschrieben, es lohnt sich jedoch zu erwähnen, dass bei dieser Einstellung beide Fokussierungsvorgänge kontinuierlich ablaufen und das Zielobjekt somit immer im Fokus bleibt.

Canon R5, Sigma 150-600/5-6.3 Contemporary, 1/4000 s, f/6.3, ISO 1600, Brennweite 324 mm

Praktische Erkenntnisse

Der Autofokus, insbesondere mit eingeschalteter Augenerkennung, ist ein großer Durchbruch im Vergleich zu Spiegelreflexkameras. Die Kamera ist in der Lage, sehr schnell selbst zu fokussieren und das gewählte Auge auch dann scharfzustellen, wenn sich die Kamera oder das Model bewegt. Es kommt nur noch selten vor, dass ein Foto durch eine um ein paar Zentimeter ungenaue Fokussierung ruiniert wird oder dass die Kamera versehentlich auf den Hintergrund scharfstellt. Der Anteil der unscharfen Bilder wurde drastisch reduziert.

Die Automatisierung ist allerdings noch nicht perfekt und wird es wahrscheinlich auch nie sein. Deshalb sollte der Fotograf immer wachsam sein, falls die Kamera das falsche Auge oder die falsche Person auswählt oder der Algorithmus das ausgewählte Motiv in der Szene verliert.

Daher ist es sehr praktisch, eine andere Taste für eine einfachere Fokussierung definiert zu haben. Ich selbst verwende diese Alternative zum Fokussieren auf den Mittelpunkt, was manchmal Bilder rettet, besonders in schnellen Reportage-Situationen.

Eine echte Revolution

Ich bin begeistert von den Fortschritten beim Fokussieren und meine Erfolgsquote beim Fotografieren hat sich im Vergleich zu Spiegelreflexkameras deutlich erhöht. Jetzt muss ich nur noch herausfinden, wie man mit der riesigen Anzahl gelungener Fotos zurechtkommt, die man nach einem Shooting zu Hause sortieren muss.